喂,AI!你懂什么叫编程吗?

原创本篇目录

当下对AI编程的普遍认知

现在提起AI写代码,几乎是一边倒的赞誉。

打开社交平台,到处都是AI几分钟写完一个页面、几秒钟生成一段接口、快速通过单元测试的案例。

于是,很多人就开始想,AI写代码又快又准,全能又高效,只要把需求丢给AI,就能自动生产出可用的软件,不仅能大幅提升效率,还能削减人力、降低成本,甚至有人直接断言,程序员很快会被AI替代。

这种看法并非没有道理。

在单次、简单、明确的场景里,AI确实表现惊人。

面对一段独立逻辑、一个小功能、一个清晰的需求,AI可以快速输出语法正确、格式规范的代码,比人工手写快几倍甚至十几倍。

也正是因为这些亮眼的短平快表现,AI编码能力被不断神化,让人误以为它在需要长期维护、持续迭代的真实项目中,同样能独当一面。

但现实却给他们泼了一盆冷水。

长期迭代中的真实表现

真正决定一个软件生死的,从来不是单次写得快不快,而是长期迭代稳不稳。

业务会变、需求会加、场景会扩、问题会冒出来,代码必须在一次次修改、扩展、修复中保持健康。

而这,正是当前AI编码模型最致命的短板。

2026年一项国际软件工程领域的SlopCodeBench研究就验证了这一点。

这项实验覆盖20个贴近真实开发的项目、总共93个迭代节点,测试了11个业界最前沿的AI编码模型,结论令人意外,却又无比真实:没有任何一个AI能从头到尾完成一个项目。

那这些AI在长期迭代中的真实表现到底如何?我们不妨通过实验数据一探究竟:

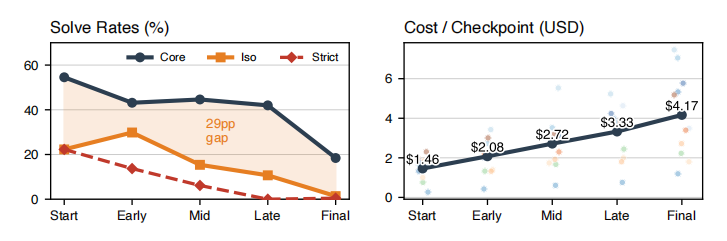

图1 (来源于文献)

从左边的曲线图可以看出,

随着项目不断推进、需求一层层叠加,这些AI的表现越来越差:

在原有代码基础上添加新功能时,仅针对本轮新增功能进行测试(对应图中黑线),这些AI的整体通过率还不到60%,而且随着后续迭代持续走低;

而全量回归测试(对应图中红线),也就是把所有功能放在一起、确保全部正常运行的测试,通过率就更低了,到了项目迭代后期更是直接崩盘,成功率逼近零。

这意味着什么?

AI可以勉强把眼前这一步的功能凑出来,但只要项目往前走、往深挖,它就守不住之前的成果。

新加的代码会破坏旧逻辑,扩展的功能会触发隐藏的Bug,看似通过了单点测试,整体系统却在不断走向脆弱、混乱、不可控。

除此之外,很多人还认为AI能省钱,真实情况恰恰相反。

右边的成本曲线告诉我们,随着迭代次数增加,AI每跑一轮要花的钱就越多,最后比刚开始贵了近3倍。

项目越往后,AI越需要反复调试、排错、修补,花费的token越来越多,等待时间越来越长,试错成本直线上升。

本来想靠AI降本增效,可真到长期迭代里,反而钱越花越多,效果却越来越差。

核心原因

为什么会出现这种现象?

这是因为AI天生就不适合长期迭代的工作方式。

程序员在写代码时,职业直觉与肌肉记忆会让他们本能思考三件事:逻辑能否扩展?接口是否会被依赖?设计是否会埋坑?

但AI不一样。

它的目标是在当前这一步满足需求、通过测试,而不是为后续的迭代负责。

它没有代码要健康的意识,不懂什么样的代码才好维护。

它会堆砌重复代码,会把逻辑硬塞在同一个函数里,会随意修改结构而不考虑连锁影响,会用大量冗余代码绕过问题,而不是从设计上根治。

随着项目一次次迭代,这种问题会越来越明显:

研究表明,在89.8%的项目里,AI写出的无效代码、重复代码会越来越多;80%的项目里,代码结构会不断恶化,越来越混乱、难维护。

AI编程的真正边界

所以,单次、短期、局部、明确的小功能,AI拥有压倒性优势,快、准、稳,能极大地减轻重复劳动。

长期、迭代、整体、复杂的项目,AI绝对不能单独扛大梁,更不能替代人。

在长期开发里,还是要人来定架构,拆模块,定义接口,制定规范,把控每一次修改的方向,审核代码质量、阻止结构腐化。

AI的定位,是在人设计好的框架里,完成具体的编码工作。

正确使用AI的方式

AI能完成当下的需求,但扛不住长期的业务变化与版本迭代。

AI能替代机械的劳动,但替代不了判断、分寸、取舍与远见。

所以我们不必神化AI,把它吹成无所不能的替代者;也不必贬低AI,把它视作威胁与搅局者。

它就是一种能力强的生产力工具,像编译器、IDE、版本控制系统一样服务于开发流程,而不是取代开发者本身。

在长期、真实、复杂的软件开发里,唯一正确、稳定、可持续的模式只有一种:

人主导架构与质量,AI负责速度与实现;人把握方向与分寸,AI填充细节与重复劳动。

不越界、不颠倒、不盲目、不焦虑。

把AI放在它擅长的位置,让人守住不可替代的位置,两者协同,才是AI编码真正的未来。

那当前时代,什么样的开发流程才能又快又稳呢?

欢迎扫码添加阿道,备注【研发流程3.0】获取详尽的流程资料。

参考文献

[1] Orlanski, G., Roy, D., Yun, A., Shin, C., Gu, A., Ge, A., Adila, D., Sala, F., & Albarghouthi, A. (2026). SlopCodeBench: Benchmarking How Coding Agents Degrade Over Long-Horizon Iterative Tasks. arXiv.

2026-04-14 10:20:18

2026-04-14 10:20:18  648

648

精品资料包

精品资料包 1V1产品演示

1V1产品演示 免费试用增强功能

免费试用增强功能 专属顾问答疑支持

专属顾问答疑支持